Modelos de razonamiento y chain-of-thought

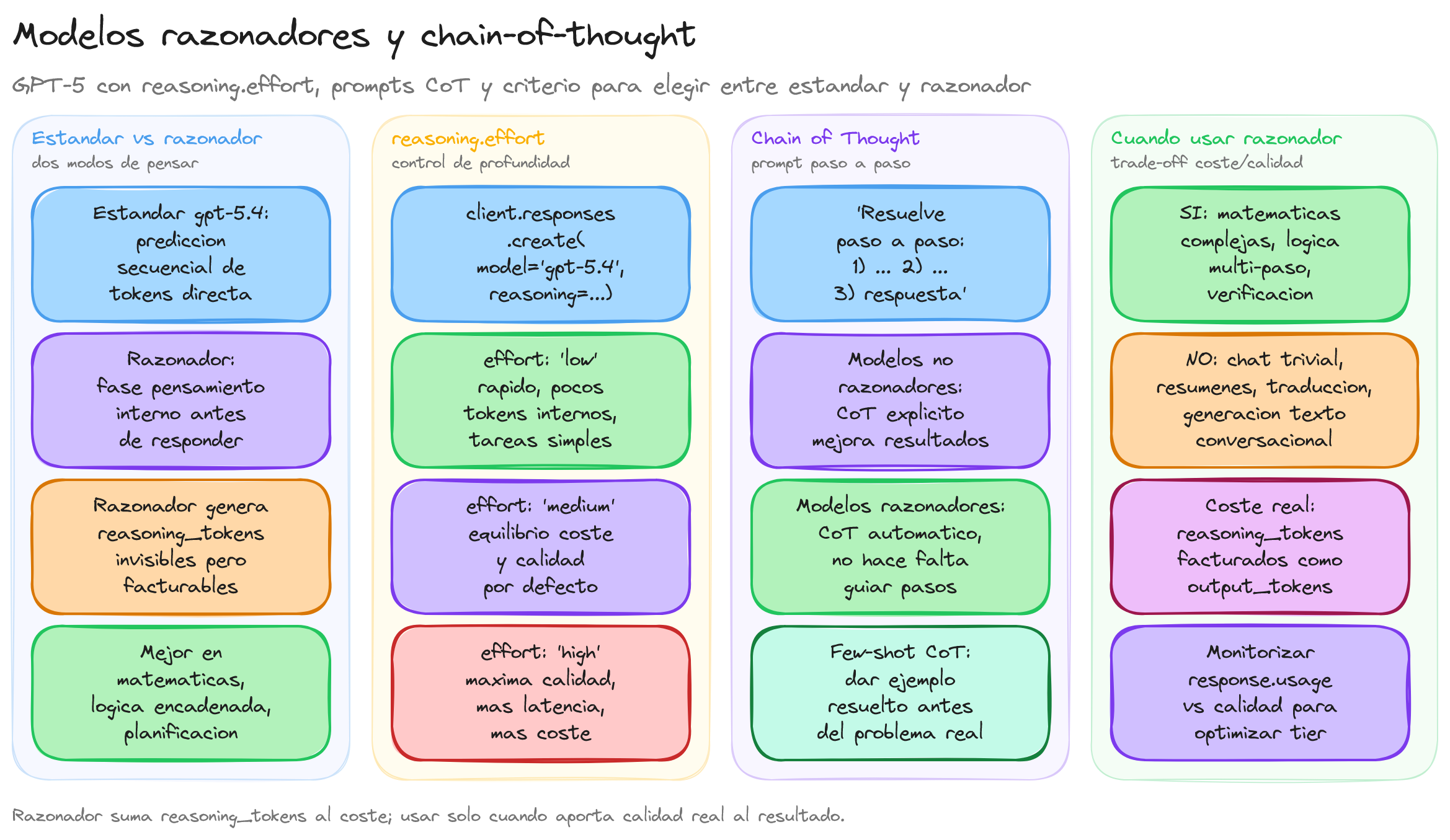

Los modelos de razonamiento representan una forma de trabajar en la que el modelo dedica más cómputo a analizar el problema antes de responder. En el catálogo actual conviene entender esta capacidad dentro de la familia GPT-5 y sus variantes, en lugar de memorizar series legacy concretas. La idea importante es distinguir entre una respuesta directa y otra donde permitimos un razonamiento más profundo para resolver problemas complejos con mayor precisión.

Diferencias fundamentales entre modelos estándar y razonadores

Los modelos estándar como gpt-5.4 generan respuestas mediante un proceso de predicción secuencial de tokens, donde cada palabra se selecciona basándose en el contexto previo. Este enfoque es eficiente para la mayoría de tareas de generación de texto, pero puede presentar limitaciones en problemas que requieren razonamiento lógico complejo o múltiples pasos de análisis.

from openai import OpenAI

client = OpenAI()

# Modelo estándar - respuesta directa

response = client.responses.create(

model="gpt-5.4",

input="Resuelve: Si tengo 15 manzanas y regalo 1/3, ¿cuántas me quedan?"

)

print(response.output_text)

# Salida típica: "Te quedan 10 manzanas."

Los modelos razonadores, por el contrario, incorporan una fase de pensamiento interno donde analizan el problema, consideran diferentes enfoques y estructuran su razonamiento antes de proporcionar la respuesta final. Este proceso se refleja en un mayor consumo de tokens y tiempo de procesamiento.

# Modelo con razonamiento más profundo

response = client.responses.create(

model="gpt-5.4",

input="Resuelve: Si tengo 15 manzanas y regalo 1/3, ¿cuántas me quedan?",

reasoning={"effort": "high"}

)

print(response.output_text)

# Salida típica incluye razonamiento:

# "Primero calculo 1/3 de 15: 15 ÷ 3 = 5 manzanas.

# Luego resto: 15 - 5 = 10 manzanas.

# Por tanto, me quedan 10 manzanas."

Técnica chain-of-thought en prompts

La técnica chain-of-thought (cadena de pensamiento) consiste en estructurar los prompts para que el modelo descomponga problemas complejos en pasos lógicos secuenciales. Esta aproximación mejora significativamente la precisión en tareas que requieren razonamiento matemático, análisis lógico o resolución de problemas multi-etapa.

Implementación básica de chain-of-thought:

prompt_cot = """

Resuelve el siguiente problema paso a paso:

Problema: Una tienda tiene 240 productos. El lunes vende 1/4 de su inventario,

el martes vende 1/3 de lo que quedaba, y el miércoles vende 20 productos más.

¿Cuántos productos quedan?

Piensa paso a paso:

1. Calcula cuántos productos se vendieron el lunes

2. Determina cuántos quedaron después del lunes

3. Calcula cuántos se vendieron el martes

4. Determina cuántos quedaron después del martes

5. Resta los productos vendidos el miércoles

6. Proporciona la respuesta final

"""

response = client.responses.create(

model="gpt-5.4",

input=prompt_cot

)

Prompts optimizados para modelos razonadores

Los modelos razonadores responden especialmente bien a prompts que explicitan la necesidad de análisis detallado y consideración de múltiples perspectivas. Estos modelos aprovechan mejor las instrucciones que solicitan verificación de resultados y exploración de enfoques alternativos.

prompt_razonador = """

Analiza el siguiente escenario empresarial y proporciona una recomendación fundamentada:

Escenario: Una startup tecnológica debe decidir entre dos estrategias de crecimiento:

- Opción A: Expansión rápida con inversión de 2M€ y riesgo alto

- Opción B: Crecimiento orgánico con inversión de 500K€ y riesgo moderado

Considera:

- Análisis de riesgos y beneficios de cada opción

- Factores del mercado actual

- Recursos disponibles de la empresa

- Escenarios de éxito y fracaso

- Recomendación final con justificación detallada

"""

response = client.responses.create(

model="gpt-5.4-pro",

input=prompt_razonador

)

Cuándo utilizar modelos razonadores vs estándar

La elección entre modelos razonadores y estándar debe basarse en la naturaleza de la tarea y los recursos disponibles. Los modelos razonadores son especialmente valiosos en escenarios que requieren:

- Resolución de problemas matemáticos complejos con múltiples variables

- Análisis lógico que involucre premisas y conclusiones encadenadas

- Toma de decisiones que requiera evaluar múltiples factores

- Verificación de información y detección de inconsistencias

- Planificación estratégica con consideración de escenarios alternativos

# Ejemplo: Selección de modelo basada en complejidad

def seleccionar_modelo(tipo_tarea):

if tipo_tarea in ["matematicas_complejas", "analisis_logico", "planificacion"]:

return "gpt-5.4-pro" # Variante para razonamiento profundo

elif tipo_tarea in ["generacion_texto", "resumen", "traduccion"]:

return "gpt-5.4" # Modelo estándar

else:

return "gpt-5.4-mini" # Modelo ligero para tareas simples

# Uso práctico

modelo = seleccionar_modelo("matematicas_complejas")

response = client.responses.create(

model=modelo,

input="Calcula la probabilidad de obtener exactamente 3 caras en 8 lanzamientos de moneda"

)

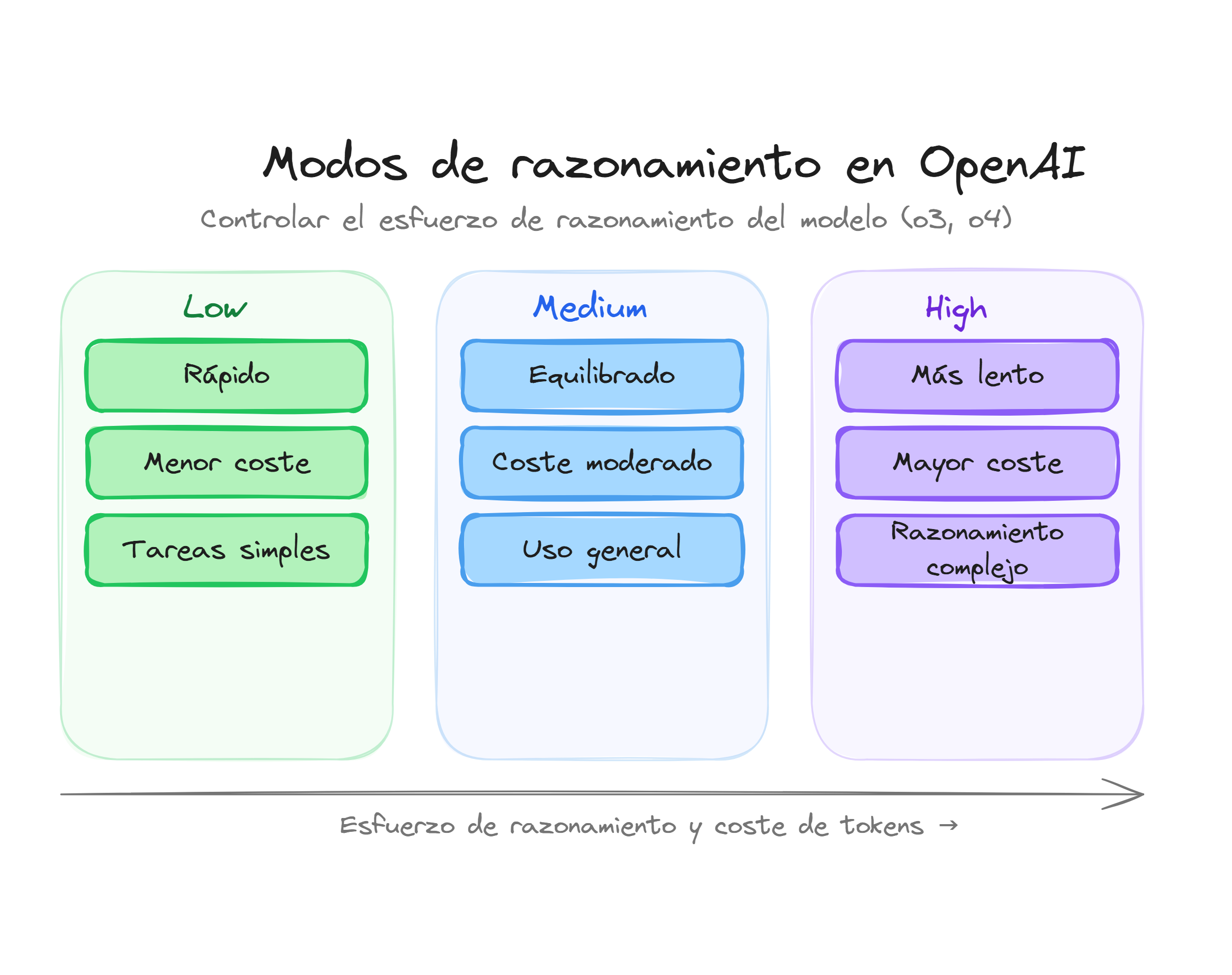

Consideraciones de costes y rendimiento

Los modelos razonadores consumen significativamente más tokens debido a su proceso interno de análisis.

Estos tokens de razonamiento se cobran a precio de output tokens:

Mientras que un modelo estándar puede generar una respuesta breve con un consumo moderado, una configuración de razonamiento alto puede disparar el número total de tokens y la latencia. Por eso conviene reservarla para problemas donde de verdad aporta calidad adicional.

# Monitorización de uso de tokens

response = client.responses.create(

model="gpt-5.4",

input="Explica la paradoja del cumpleaños en probabilidad",

reasoning={"effort": "high"}

)

# Revisa el consumo total para entender el coste real

print(f"Tokens de entrada: {response.usage.input_tokens}")

print(f"Tokens de salida: {response.usage.output_tokens}")

print(f"Total: {response.usage.total_tokens}")

Esta diferencia en el consumo de recursos hace que la selección estratégica del modelo sea crucial para optimizar tanto la calidad de las respuestas como la eficiencia económica del sistema.

Fuentes y referencias

Documentación oficial y recursos externos para profundizar en OpenAI SDK

Documentación oficial de OpenAI SDK

Alan Sastre

Ingeniero de Software y formador, CEO en CertiDevs

Ingeniero de software especializado en Full Stack y en Inteligencia Artificial. Como CEO de CertiDevs, OpenAI SDK es una de sus áreas de expertise. Con más de 15 años programando, 6K seguidores en LinkedIn y experiencia como formador, Alan se dedica a crear contenido educativo de calidad para desarrolladores de todos los niveles.

Más tutoriales de OpenAI SDK

Explora más contenido relacionado con OpenAI SDK y continúa aprendiendo con nuestros tutoriales gratuitos.

Aprendizajes de esta lección

Comprender la diferencia entre modelos estándar y modelos razonadores en IA. Aprender cómo los modelos razonadores realizan un proceso interno de pensamiento estructurado. Conocer la técnica chain-of-thought para descomponer problemas complejos en pasos lógicos. Identificar cuándo es adecuado utilizar modelos razonadores frente a modelos estándar. Evaluar las implicaciones de costes y rendimiento al usar modelos razonadores.