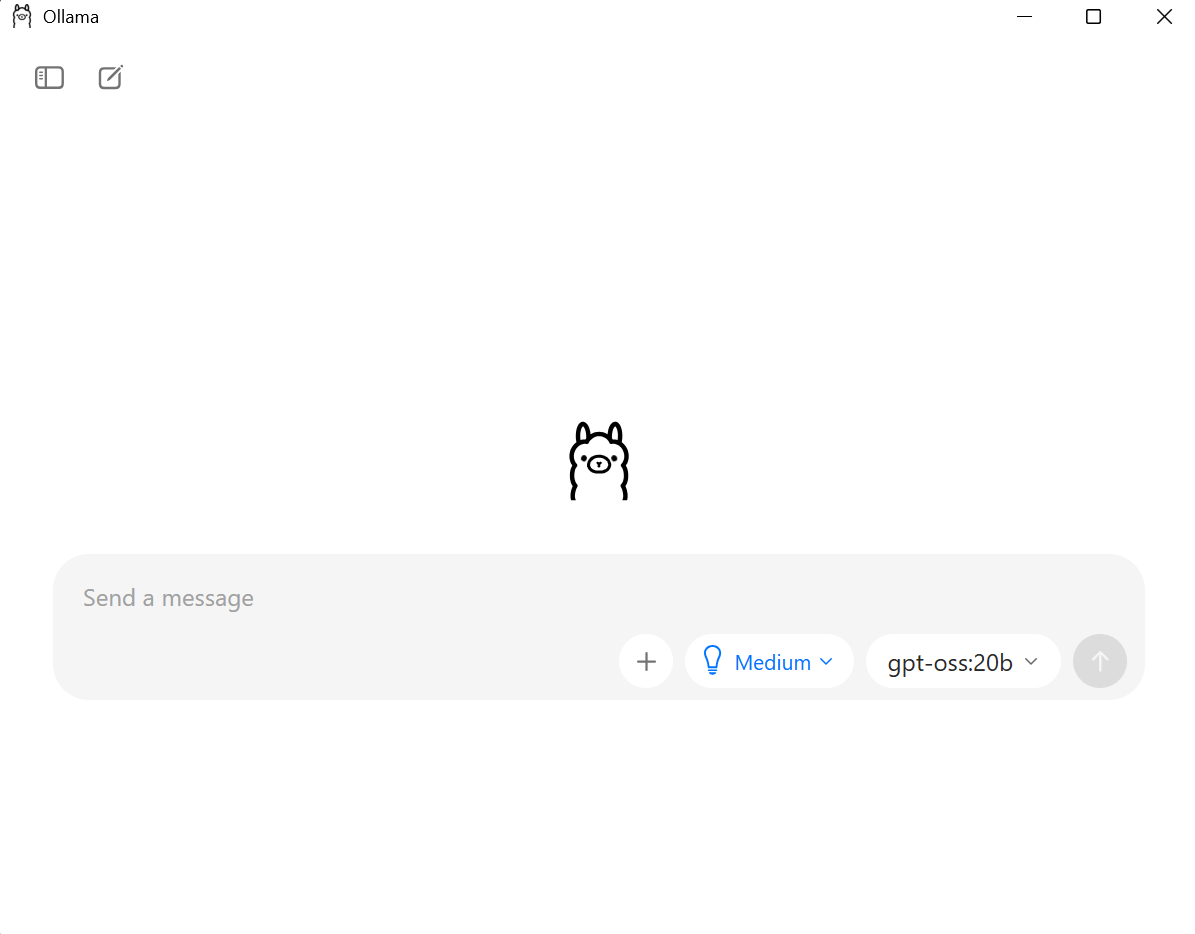

La interfaz de escritorio

A partir de versiones recientes (desde Ollama 0.10 en adelante), Ollama incluye una aplicación de escritorio que ofrece una interfaz gráfica para chatear con los modelos sin usar la terminal. Se instala junto con el resto de Ollama cuando descargas el instalador desde la web oficial y suele estar disponible desde el menú de inicio (Windows), el Launchpad o Aplicaciones (macOS) o el menú de aplicaciones en Linux. Al abrirla, se conecta al mismo servidor que usa la CLI y la API: si el servidor no está en marcha, la aplicación puede arrancarlo automáticamente, de modo que no tienes que lanzar ningún proceso a mano para empezar a chatear.

La ventaja principal es que no necesitas teclear comandos para probar un modelo: eliges el modelo en la interfaz, escribes en un cuadro de texto y recibes la respuesta en un formato de chat similar al de un asistente conversacional.

Es útil para explorar modelos, hacer pruebas rápidas de prompts o usar Ollama de forma más cómoda si prefieres no trabajar solo en terminal. La experiencia es coherente con lo que obtendrías usando la CLI en modo interactivo, pero con una interfaz pensada para uso gráfico.

flowchart TD

A["Aplicación de escritorio"] --> B["Servidor Ollama<br/>se inicia automáticamente"]

A --> C["Interfaz de chat<br/>con streaming"]

A --> D["Historial de<br/>conversaciones"]

A --> E["Entrada multimodal<br/>texto, imágenes, archivos"]

C --> F["Selección de modelo<br/>sin comandos"]

Interfaz tipo chatbot

La aplicación se organiza como un chat: una lista de conversaciones (o una conversación activa) y un área donde escribes el mensaje y ves las respuestas del modelo. Puedes cambiar de modelo desde la propia interfaz sin tener que cerrar la aplicación ni ejecutar comandos. Los mensajes se muestran en orden cronológico y el modelo responde en la misma ventana, a menudo con streaming (el texto va apareciendo poco a poco), igual que cuando usas ollama run en la terminal.

No sustituye a la CLI ni a la API para automatización o integración en código, pero cubre bien el uso interactivo y la exploración de modelos. Para desarrollo, scripts o integraciones con otras herramientas, seguirás usando la API o los comandos de la CLI.

Historial de conversaciones

La aplicación de escritorio mantiene historial de las conversaciones: puedes volver a conversaciones anteriores, continuarlas o abrir varias a la vez según lo que permita la interfaz. Eso te permite comparar respuestas entre modelos, retomar un hilo de preguntas o guardar contexto sin tener que copiar y pegar en la terminal. El historial se almacena localmente y está asociado a tu instalación de Ollama, no a una cuenta en la nube, salvo que uses funciones vinculadas a Ollama Cloud.

Multimodalidad: imágenes y archivos

Muchos modelos en Ollama soportan entrada multimodal: además de texto, puedes enviar imágenes o, según el modelo, archivos desde la aplicación de escritorio. La interfaz suele permitir adjuntar una imagen al mensaje (por ejemplo, arrastrando o seleccionando un archivo) y el modelo puede describirla, responder preguntas sobre ella o combinarla con el texto del prompt. Esto es especialmente útil con modelos de visión (vision-language) disponibles en el catálogo de Ollama.

No todos los modelos soportan visión: en la interfaz o en la documentación verás indicado qué modelos son multimodales. Para uso solo con texto, cualquier modelo de chat sirve desde la aplicación de escritorio igual que desde la terminal o la API.

Selección de modelos y configuración

Desde la aplicación de escritorio puedes cambiar de modelo en cualquier momento sin cerrar la interfaz. Un selector o menú desplegable muestra los modelos disponibles (los que hayas descargado con ollama pull o que estén accesibles vía Ollama Cloud). Al cambiar de modelo, la conversación en curso puede continuar o iniciarse de nuevo según la implementación de la interfaz en tu versión.

La aplicación también permite ajustar algunos parámetros de generación directamente desde la interfaz, como la temperatura o la longitud máxima de respuesta, dependiendo de la versión. Para configuraciones más avanzadas (system prompt personalizado, parámetros específicos del modelo), la CLI y la API siguen siendo el canal más flexible.

Diferencias con la CLI y la API

La aplicación de escritorio y la CLI comparten el mismo servidor y los mismos modelos, pero están pensadas para usos distintos:

| Aspecto | Aplicación de escritorio | CLI (ollama run) | API REST |

|---------|--------------------------|--------------------|---------:|

| Uso principal | Exploración y chat diario | Pruebas rápidas y scripting | Integración en código |

| Interfaz | Gráfica con historial | Terminal interactiva | HTTP/JSON |

| Multimodal | Arrastrar imágenes | Ruta de archivo en el comando | Base64 en JSON |

| Historial | Persistente entre sesiones | Solo la sesión actual | Gestionado por la aplicación |

| Automatización | No | Parcial (scripts con prompt) | Completa |

Para desarrollo, automatización o integración con otras herramientas, la API es la opción más potente. La aplicación de escritorio es ideal para uso personal diario: probar modelos, hacer preguntas rápidas, comparar respuestas entre modelos y mantener un registro de las conversaciones sin necesidad de abrir una terminal.

Acceso desde la bandeja del sistema

En Windows y macOS, Ollama coloca un icono en la bandeja del sistema (system tray) o en la barra de menú. Desde ahí puedes abrir la aplicación de escritorio, comprobar si el servidor está en marcha, ver qué modelos están cargados en memoria y acceder a la configuración. Es una forma rápida de gestionar Ollama sin abrir una terminal ni buscar la aplicación en el menú de inicio.

La aplicación de escritorio te da una interfaz nativa para chatear con los modelos, consultar el historial y usar contenido multimodal sin depender de la línea de comandos, usando el mismo servidor y los mismos modelos que el resto del ecosistema Ollama.

Alan Sastre

Ingeniero de Software y formador, CEO en CertiDevs

Ingeniero de software especializado en Full Stack y en Inteligencia Artificial. Como CEO de CertiDevs, Ollama es una de sus áreas de expertise. Con más de 15 años programando, 6K seguidores en LinkedIn y experiencia como formador, Alan se dedica a crear contenido educativo de calidad para desarrolladores de todos los niveles.

Más tutoriales de Ollama

Explora más contenido relacionado con Ollama y continúa aprendiendo con nuestros tutoriales gratuitos.

Aprendizajes de esta lección

Conocer la interfaz de escritorio de Ollama: chat con modelos, historial de conversaciones y soporte para contenido multimodal.

Cursos que incluyen esta lección

Esta lección forma parte de los siguientes cursos estructurados con rutas de aprendizaje