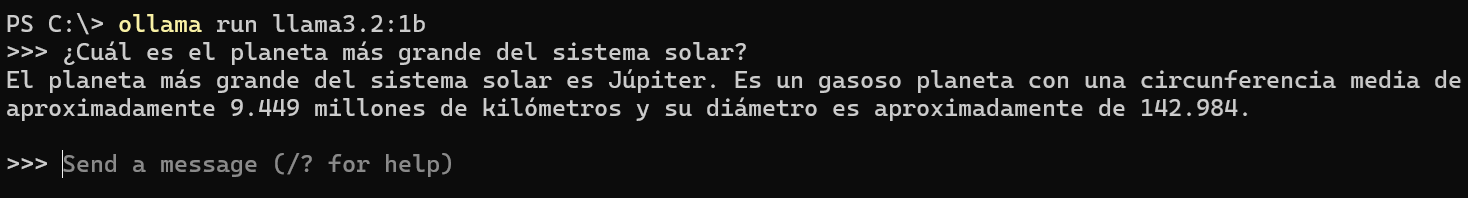

Ejecutar un modelo con ollama run

El comando ollama run arranca una sesión interactiva en la terminal donde puedes chatear con el modelo: escribes mensajes, el modelo responde y el historial de la conversación se mantiene en esa sesión. La sintaxis básica es:

ollama run nombre-modelo

Si el modelo no está descargado, Ollama puede ofrecer descargarlo (según la versión) o mostrar un error indicando que debes hacer antes ollama pull nombre-modelo. Si el modelo ya está en tu máquina, se carga y se abre el prompt en la terminal, listo para que escribas.

Ejemplo con un modelo local:

ollama run llama3.2

Verás una línea de bienvenida y un cursor donde puedes escribir. Cada vez que envías un mensaje (Intro), el modelo genera la respuesta y luego puedes seguir escribiendo. Para salir del chat interactivo suele usarse /bye o la secuencia de teclas que indique la documentación (por ejemplo Ctrl+D en algunas configuraciones).

Ejecutar un modelo en la nube con :cloud

Si tienes Ollama Cloud configurado (cuenta y ollama signin), puedes ejecutar un modelo sin tenerlo en local usando el sufijo :cloud en el nombre:

ollama run llama3.2:cloud

En ese caso la inferencia se realiza en los servidores de Ollama. No hace falta haber hecho ollama pull para ese modelo. La experiencia en la terminal es la misma: chat interactivo, pero el modelo corre en la nube y consume los recursos remotos según la política de tu cuenta.

Usar

:cloudes útil cuando no quieres descargar un modelo grande o cuando tu equipo no tiene recursos suficientes para ejecutarlo en local.

Pasar un prompt desde la línea de comandos

Puedes enviar un único mensaje al modelo sin entrar en el chat interactivo pasando el texto como argumento:

ollama run llama3.2 "Explica en una frase qué es un LLM"

Ollama ejecuta el modelo, genera la respuesta para ese prompt y termina. Resulta cómodo para scripts o para probar algo rápido sin abrir la sesión interactiva. Con modelos que soportan imágenes (vision), puedes incluir la ruta a un archivo en el mismo comando según la sintaxis documentada para tu versión.

Parámetros básicos de generación

En el chat interactivo o en llamadas por API puedes influir en cómo genera el modelo. Los más habituales son:

-

Temperature: controla la aleatoriedad. Valores bajos (cercanos a 0) dan respuestas más deterministas y repetibles, y valores altos (cercanos a 2) más variadas y creativas. Para tareas de código o respuestas precisas suele usarse un valor bajo, y para brainstorming o redacción más libre, algo más alto.

-

Top-p (nucleus sampling): limita la elección de tokens a un subconjunto acumulado de probabilidad. Valores más bajos restringen más las opciones y suelen hacer la salida más coherente y predecible.

-

Num_predict / max tokens: número máximo de tokens que el modelo puede generar en una respuesta. Útil para limitar la longitud y el tiempo de espera.

Estos parámetros se configuran normalmente desde la API (por ejemplo en una petición POST a /api/generate o /api/chat) o desde la interfaz de la aplicación de escritorio. En la CLI interactiva no suelen pasarse en cada comando, la CLI usa valores por defecto del servidor. Para automatizar o afinar el comportamiento, la API es el canal adecuado.

Si necesitas probar distintos valores de temperature o top_p de forma repetida, usa la API o un script que llame a la API en lugar del chat interactivo de la terminal.

Flujo típico de uso en terminal

flowchart LR

A[ollama run modelo] --> B{¿Modelo local?}

B -->|Sí| C[Cargar desde disco]

B -->|No, modelo:cloud| D[Enviar a Ollama Cloud]

C --> E[Chat interactivo]

D --> E

E --> F[Escribir mensajes]

F --> G[Recibir respuesta]

G --> F

Comandos especiales dentro del chat interactivo

Dentro de la sesión interactiva de ollama run, puedes usar comandos que empiezan por / para controlar el comportamiento sin salir del chat:

| Comando | Descripción |

|---------|-------------|

| /bye | Salir del chat interactivo. |

| /set system <texto> | Definir un mensaje de sistema para la conversación actual. |

| /set think | Activar el razonamiento extendido (thinking) si el modelo lo soporta. |

| /set nothink | Desactivar thinking. |

| /set parameter temperature 0.5 | Cambiar un parámetro de generación en caliente. |

| /show info | Mostrar información del modelo cargado. |

| /show modelfile | Mostrar el Modelfile del modelo actual. |

| /clear | Limpiar el historial de la conversación actual. |

| /load <modelo> | Cambiar a otro modelo sin salir de la sesión. |

| /save <nombre> | Guardar la conversación actual. |

Estos comandos permiten ajustar el comportamiento del modelo sobre la marcha: por ejemplo, activar thinking para una pregunta de razonamiento, cambiar la temperatura para una respuesta más creativa o limpiar el contexto cuando la conversación se ha alargado demasiado.

Redirección de entrada y salida

Puedes usar ollama run en scripts redirigiendo la entrada desde un archivo o un pipe:

echo "Resume este texto en una frase: $(cat articulo.txt)" | ollama run llama3.2

O pasar el contenido de un archivo como prompt:

ollama run llama3.2 "Traduce al inglés: $(cat texto-es.txt)"

Esto permite integrar Ollama en flujos de trabajo automatizados: traducir lotes de documentos, resumir artículos, generar descripciones a partir de datos o cualquier tarea donde quieras usar un LLM desde la línea de comandos sin escribir código que llame a la API.

En la práctica: eliges el modelo por nombre (y tag si aplica), usas :cloud si quieres que corra en la nube, y en la sesión interactiva escribes y recibes respuestas. Para salir, usas /bye o Ctrl+D. A partir de ahí, gestionar qué modelos están en ejecución o liberar recursos se hace con ollama ps, ollama stop y, para el catálogo local, ollama rm y ollama copy.

Alan Sastre

Ingeniero de Software y formador, CEO en CertiDevs

Ingeniero de software especializado en Full Stack y en Inteligencia Artificial. Como CEO de CertiDevs, Ollama es una de sus áreas de expertise. Con más de 15 años programando, 6K seguidores en LinkedIn y experiencia como formador, Alan se dedica a crear contenido educativo de calidad para desarrolladores de todos los niveles.

Más tutoriales de Ollama

Explora más contenido relacionado con Ollama y continúa aprendiendo con nuestros tutoriales gratuitos.

Aprendizajes de esta lección

Ejecutar modelos con ollama run en local y con modelo:cloud, usar el chat interactivo en terminal y conocer parámetros básicos de generación.

Cursos que incluyen esta lección

Esta lección forma parte de los siguientes cursos estructurados con rutas de aprendizaje