Descargar modelos con ollama pull

Para usar un modelo en local necesitas descargarlo primero. El comando ollama pull obtiene el modelo desde el registro de Ollama (o desde Ollama Cloud si aplica) y lo guarda en tu máquina. La sintaxis básica es:

ollama pull nombre-modelo

Por ejemplo, para descargar el modelo Llama 3.2:

ollama pull llama3.2

El servidor de Ollama descarga los archivos del modelo (pesos, metadatos) y los almacena en el directorio que usa tu instalación (por ejemplo, en Linux/macOS suele ser ~/.ollama/models). Una vez terminada la descarga, el modelo queda disponible para ollama run y para la API.

La primera vez que ejecutas

ollama pulloollama runcon un modelo que no está en disco, el servidor puede arrancar automáticamente si no estaba ya en marcha.

flowchart TD

A["ollama pull modelo"] --> B{"¿Tiene tag?"}

B -->|"modelo:tag"| C["Descarga variante concreta<br/>ej. llama3.2:3b"]

B -->|"Sin tag"| D["Descarga variante latest"]

C --> E["Modelo en disco"]

D --> E

E --> F["ollama list<br/>Ver modelos descargados"]

G["modelo:cloud"] --> H["Sin descarga<br/>Ejecución remota en la nube"]

Variantes y tags (modelo:tag)

Un mismo nombre de modelo puede tener varias variantes: por ejemplo distintas cuantizaciones (4B, 8B, 70B), versiones (1.0, 2.0) o variantes específicas (instruct, code). En Ollama se identifican con un tag en la forma modelo:tag.

Ejemplos:

llama3.2:latestusa la variante por defecto (suele ser la recomendada).llama3.2:3bdescarga la versión de 3B parámetros.llama3.2:1bla de 1B.

Si no indicas tag, Ollama suele tomar latest como valor por defecto. Para ver qué tags tiene un modelo puedes consultar la página de modelos de Ollama o la documentación del modelo.

ollama pull llama3.2:3b

Así te aseguras de descargar la variante de 3B en lugar de la que esté marcada como latest.

Usar modelos en la nube con :cloud

Si tienes Ollama Cloud configurado (cuenta y autenticación con ollama signin), puedes usar modelos sin descargarlos añadiendo el sufijo :cloud al nombre. En ese caso no hace falta hacer ollama pull: la inferencia se ejecuta en los servidores de Ollama.

Para listar qué modelos tienes en local sigues usando ollama list. Los modelos que solo uses con :cloud no aparecerán en esa lista como archivos en disco, porque no están instalados en tu máquina.

Si en tu entorno no debe usarse la nube, define la variable de entorno

OLLAMA_NO_CLOUD=1. Así se evita que comandos o aplicaciones intenten usar modelos remotos.

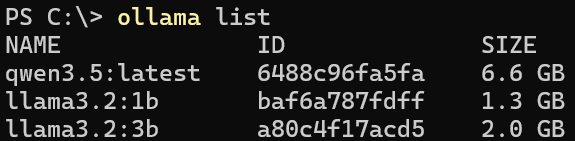

Listar modelos instalados con ollama list

Para ver qué modelos tienes descargados en tu máquina usa:

ollama list

También existe la forma abreviada ollama ls, que hace lo mismo. La salida muestra una tabla con el nombre del modelo (incluido el tag si existe), el tamaño en disco y la fecha de modificación. Así puedes comprobar rápidamente si un modelo está disponible antes de ejecutarlo o si quieres liberar espacio eliminando alguno.

Ejemplo de salida típica:

NAME ID SIZE MODIFIED

llama3.2:3b a1b2c3d4e5f6 2.1 GB 2 minutes ago

llama3.2:latest b2c3d4e5f6a7 4.2 GB 1 hour ago

qwen3.5:latest c3d4e5f6a7b8 4.8 GB 3 days ago

Con esa información puedes decidir si necesitas hacer otro ollama pull (por ejemplo para una variante distinta), si debes eliminar un modelo con ollama rm para liberar espacio o simplemente elegir el nombre exacto (con tag) para ollama run.

Resumen de comandos de descarga y listado

| Acción | Comando |

|---------------------|-------------------|

| Descargar modelo | ollama pull nombre o ollama pull nombre:tag |

| Listar modelos locales | ollama list o ollama ls |

| Usar modelo sin descargar (nube) | Añadir :cloud al nombre, por ejemplo ollama run llama3.2:cloud |

Una vez que sabes qué modelos tienes y cómo descargar otros, el siguiente paso es ejecutarlos en la terminal con ollama run y, si hace falta, gestionar los procesos y el catálogo con ollama ps, ollama stop, ollama rm y ollama copy.

Alan Sastre

Ingeniero de Software y formador, CEO en CertiDevs

Ingeniero de software especializado en Full Stack y en Inteligencia Artificial. Como CEO de CertiDevs, Ollama es una de sus áreas de expertise. Con más de 15 años programando, 6K seguidores en LinkedIn y experiencia como formador, Alan se dedica a crear contenido educativo de calidad para desarrolladores de todos los niveles.

Más tutoriales de Ollama

Explora más contenido relacionado con Ollama y continúa aprendiendo con nuestros tutoriales gratuitos.

Aprendizajes de esta lección

Usar ollama pull para descargar modelos, entender variantes y tags (modelo:tag), usar :cloud para modelos en la nube y listar el catálogo local con ollama list.

Cursos que incluyen esta lección

Esta lección forma parte de los siguientes cursos estructurados con rutas de aprendizaje