Descarga e instalación por sistema operativo

Ollama se distribuye como aplicación nativa para Windows, macOS y Linux. La forma más directa de instalarlo es descargar el instalador desde la página oficial ollama.com/download y seguir los pasos del asistente en cada plataforma. No hace falta configurar entornos virtuales ni dependencias manuales: el instalador incluye el binario, las librerías necesarias y, en su caso, la integración con el sistema (acceso desde la terminal, icono en la bandeja, etc.).

Windows

La documentación oficial ofrece dos vías: descargar el instalador OllamaSetup.exe desde la web o ejecutar el script de instalación en PowerShell. En ambos casos Ollama queda añadido al PATH y disponible desde la terminal (PowerShell, CMD o Windows Terminal) y desde el menú de inicio. Se requiere Windows 10 o posterior. Tras la instalación, Ollama coloca un icono en la bandeja del sistema que permite arrancar y detener el servidor. Si usas GPU NVIDIA, el instalador detecta CUDA automáticamente y lo configura para acelerar la inferencia.

# Verificar la instalación en PowerShell

ollama --version

macOS

Se descarga el archivo .dmg desde la web oficial, se arrastra la aplicación a la carpeta Aplicaciones y se ejecuta. En equipos con Apple Silicon (M1, M2, M3, M4), Ollama aprovecha Metal para acelerar la inferencia sin configuración adicional. El binario ollama queda disponible en la terminal si aceptas la instalación de las herramientas de línea de comandos. También puedes instalar con Homebrew si prefieres gestionar paquetes desde la terminal:

brew install ollama

Linux

Hay paquetes para distribuciones habituales (Debian/Ubuntu, Fedora, Arch, etc.) y también un script de instalación oficial que detecta la distribución y configura el repositorio o instala el binario según corresponda:

curl -fsSL https://ollama.com/install.sh | sh

Este script añade el repositorio, instala el paquete, crea un servicio systemd para que el servidor arranque con el sistema y detecta GPU NVIDIA (CUDA) o AMD (ROCm) si están disponibles. En distribuciones sin systemd, el servidor se lanza manualmente con ollama serve.

La documentación oficial en ollama.com indica la opción recomendada para cada sistema y cómo instalar desde línea de comandos si prefieres no usar la interfaz gráfica del instalador. Conviene seguir las instrucciones del sitio para tu sistema operativo concreto.

flowchart LR

A{"Sistema operativo"} -->|"Windows"| B["OllamaSetup.exe<br/>o PowerShell"]

A -->|"macOS"| C["Descargar .dmg"]

A -->|"Linux"| D["Paquete o script<br/>de instalación"]

B --> E["ollama --version<br/>Verificar instalación"]

C --> E

D --> E

E --> F["ollama run modelo<br/>Primer uso"]

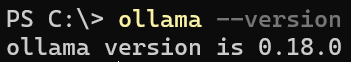

Verificar la instalación

Una vez instalado, conviene comprobar que el comando ollama está disponible y que la versión instalada es la esperada. En cualquier terminal (PowerShell, Terminal.app, bash, etc.) ejecuta:

ollama --version

Si la instalación ha sido correcta, verás una línea con el número de versión (por ejemplo ollama version 0.x.x). Eso confirma que el cliente CLI está en el PATH y que podrás usar comandos como ollama run, ollama list o ollama pull cuando arranque el servidor.

El servidor (el proceso que realmente ejecuta los modelos) suele iniciarse automáticamente la primera vez que usas un comando que lo requiere (por ejemplo, al hacer ollama run nombre-modelo). No es necesario lanzarlo a mano para una instalación básica en un solo equipo: la aplicación de escritorio o la CLI lo arrancan cuando hace falta.

Requisitos mínimos de sistema

Aunque Ollama corre en equipos modestos, el rendimiento y los modelos que puedas usar dependen del hardware:

-

RAM: 8 GB permiten usar modelos pequeños (por ejemplo 7B en cuantización). Para modelos más grandes o varios modelos cargados a la vez, 16 GB o más son recomendables.

-

Almacenamiento: cada modelo ocupa varios GB (desde unos pocos hasta decenas). Conviene tener espacio libre suficiente para los modelos que vayas a descargar.

-

GPU (opcional): acelera mucho la inferencia. Ollama aprovecha GPU NVIDIA (CUDA), AMD (ROCm) y Apple Silicon (Metal) cuando están disponibles. Sin GPU, los modelos se ejecutan en CPU, que es más lento pero válido para pruebas y modelos pequeños.

Directorio de modelos y almacenamiento

Ollama almacena los modelos descargados en un directorio local que varía según el sistema operativo:

- macOS y Linux:

~/.ollama/modelspor defecto. - Windows:

C:\Users\<usuario>\.ollama\models.

Puedes cambiar este directorio con la variable de entorno OLLAMA_MODELS si necesitas que los modelos se almacenen en otro disco o partición (por ejemplo, un SSD más rápido o un volumen con más espacio). Cada modelo ocupa desde unos pocos hasta decenas de gigabytes, así que conviene elegir un disco con espacio suficiente para los modelos que vayas a usar.

Primer uso: descargar y ejecutar un modelo

Con la instalación verificada, el servidor se pondrá en marcha automáticamente cuando uses la aplicación de escritorio o un comando que lo requiera. Para probar que todo funciona, descarga y ejecuta un modelo directamente:

ollama run llama3.2

Si el modelo no está descargado, Ollama lo descarga automáticamente antes de iniciar el chat. La primera descarga puede tardar varios minutos según el tamaño del modelo y la velocidad de tu conexión. Una vez descargado, se abre una sesión interactiva donde puedes escribir mensajes y recibir respuestas del modelo en la terminal.

Actualización de Ollama

Ollama se actualiza con frecuencia para añadir soporte a nuevos modelos, mejorar el rendimiento y corregir errores. En Windows y macOS, la aplicación de escritorio suele notificar actualizaciones disponibles. En Linux, si usaste el script de instalación, puedes repetirlo para obtener la versión más reciente. Con Homebrew en macOS se usa brew upgrade ollama. Conviene mantener Ollama actualizado para aprovechar las mejoras en velocidad de inferencia, nuevas capacidades como thinking o búsqueda web, y la compatibilidad con los modelos más recientes del catálogo.

A partir de ahí puedes descargar y usar modelos desde la CLI o desde la interfaz gráfica.

Alan Sastre

Ingeniero de Software y formador, CEO en CertiDevs

Ingeniero de software especializado en Full Stack y en Inteligencia Artificial. Como CEO de CertiDevs, Ollama es una de sus áreas de expertise. Con más de 15 años programando, 6K seguidores en LinkedIn y experiencia como formador, Alan se dedica a crear contenido educativo de calidad para desarrolladores de todos los niveles.

Más tutoriales de Ollama

Explora más contenido relacionado con Ollama y continúa aprendiendo con nuestros tutoriales gratuitos.

Aprendizajes de esta lección

Descargar e instalar Ollama en tu sistema y comprobar que el entorno queda listo para usar modelos.

Cursos que incluyen esta lección

Esta lección forma parte de los siguientes cursos estructurados con rutas de aprendizaje