Qué es Claude Code y cómo se conecta a Ollama

Claude Code es la herramienta de Anthropic para asistencia de codificación en terminal: puede leer, modificar y ejecutar código en tu directorio de trabajo. Por defecto está pensada para usar la API de Anthropic con modelos de pago. Ollama, desde versiones recientes, expone una API compatible con Anthropic, de modo que Claude Code puede usar modelos abiertos alojados en tu máquina (Ollama local) o en Ollama Cloud sin depender de la API comercial de Anthropic.

La compatibilidad con la API de Anthropic permite que el mismo cliente (Claude Code) hable con Ollama cambiando solo la URL base y la autenticación.

Así puedes tener un asistente de código en terminal que use modelos como qwen3.5, glm-4.7-flash o qwen3.5:cloud y kimi-k2.5:cloud, según tengas el servidor local en marcha o prefieras usar la nube.

Configuración rápida con ollama launch claude

La forma más sencilla de usar Claude Code con Ollama es el comando ollama launch claude. Ollama se encarga de preparar el entorno (variables de entorno y, si hace falta, la instalación de Claude Code) y de lanzar la herramienta apuntando a tu instancia de Ollama.

ollama launch claude

Con eso, Claude Code arranca y usa por defecto el backend de Ollama. Si quieres elegir un modelo concreto al lanzar, usa la opción --model.

Modelo local (por ejemplo uno ligero para equipos con pocos recursos):

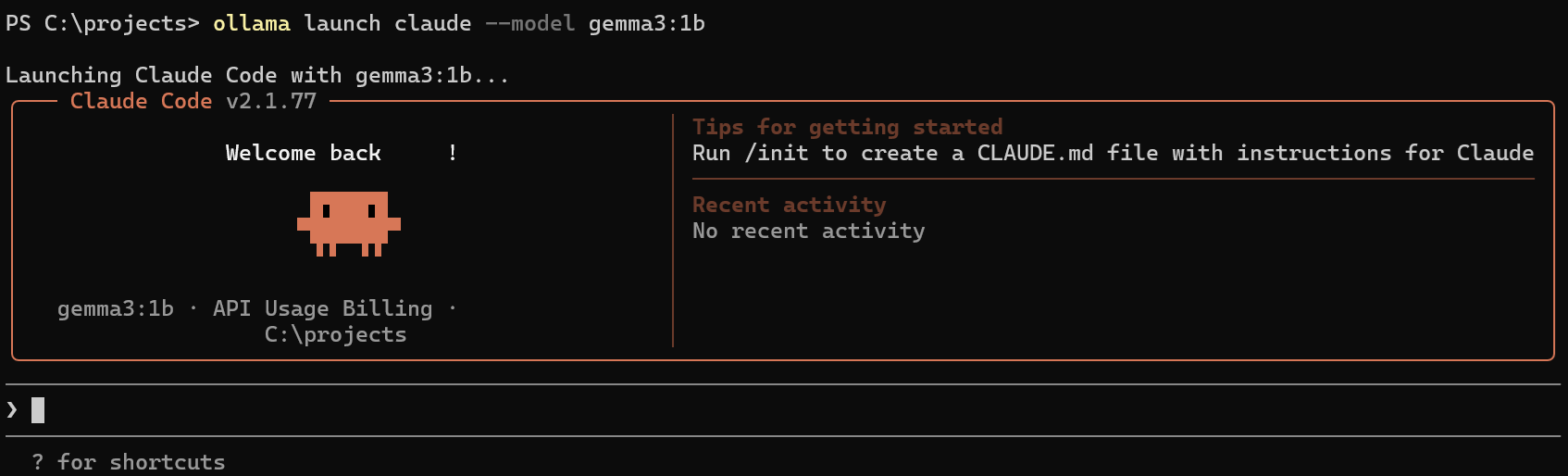

ollama launch claude --model gemma3:1b

Modelo en la nube (Ollama Cloud), por ejemplo GLM-5 o Qwen 3.5:

ollama launch claude --model glm-5:cloud

ollama launch claude --model qwen3.5:cloud

Para otros modelos locales más grandes usa el nombre sin sufijo (por ejemplo --model qwen3.5 o --model glm-4.7-flash). Para modelos en la nube, el sufijo :cloud indica que se usa el servicio Ollama Cloud (requiere cuenta y ollama signin).

Requisitos habituales: que Ollama esté en ejecución (local o con cuenta en la nube), que Claude Code esté instalado (el comando puede guiarte en la instalación) y que el modelo elegido tenga una ventana de contexto suficiente. La documentación de Ollama recomienda al menos 64k tokens de contexto para Claude Code. Los modelos ligeros como gemma3:1b (32k) sirven para probar en equipos limitados, pero para proyectos grandes conviene usar modelos con más contexto. Puedes ajustar el contexto en Ollama según el modelo y tu hardware.

Menú ollama launch y opción --config

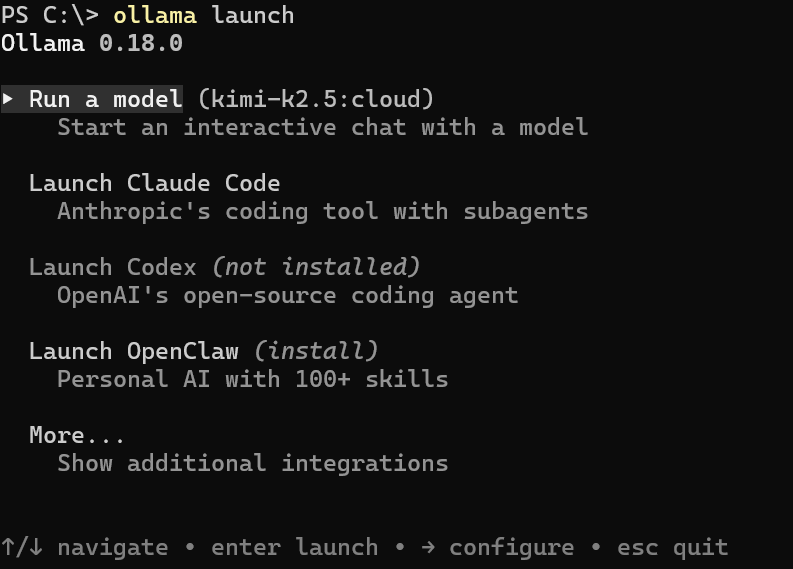

El comando ollama launch sin argumentos muestra un menú con las integraciones disponibles (Claude Code, Codex, Droid, OpenCode, etc.). Desde ahí eliges con qué herramienta quieres trabajar y Ollama configura y lanza la que selecciones.

Si solo quieres generar o revisar la configuración sin arrancar la herramienta, usa --config. Útil para ver qué variables de entorno o parámetros se usarían, o para integrar Ollama en tus propios scripts.

ollama launch claude --config

Con esto no se ejecuta Claude Code, pero puedes inspeccionar la configuración que Ollama aplicaría (por ejemplo ANTHROPIC_BASE_URL, ANTHROPIC_AUTH_TOKEN) y reutilizarla en otro entorno o en un script propio.

flowchart LR

U[Usuario] --> O[ollama launch]

O --> M[Menú integraciones]

M --> C[Claude Code]

M --> X[Otras herramientas]

O --> D[ollama launch claude]

D --> E[Variables entorno]

E --> A[Claude Code]

A --> B[Ollama local o Cloud]

Configuración manual con variables de entorno

Si prefieres no usar ollama launch y lanzar Claude Code tú mismo (por ejemplo desde otro script o con otra configuración), puedes definir las variables de entorno que Claude Code usa para conectarse a la API de Anthropic y apuntarlas a Ollama.

En entornos tipo Unix:

export ANTHROPIC_AUTH_TOKEN=ollama

export ANTHROPIC_API_KEY=""

export ANTHROPIC_BASE_URL=http://localhost:11434

claude --model qwen3.5

En local, ANTHROPIC_AUTH_TOKEN puede ser cualquier valor (por ejemplo ollama). Lo importante es ANTHROPIC_BASE_URL apuntando a tu servidor Ollama. Para Ollama Cloud usarías la URL del servicio y, si el cliente lo requiere, una API key válida en las variables que Claude Code consulte.

Con esto, Claude Code enviará las peticiones a Ollama en lugar de a la API de Anthropic y podrás usar modelos locales o modelo:cloud según el nombre que pases con --model.

Modelos recomendados y tareas programadas

La documentación de Ollama suele recomendar modelos como qwen3.5, glm-4.7-flash para uso local y qwen3.5:cloud, minimax-m2.5:cloud, glm-5:cloud, kimi-k2.5:cloud para la nube. Conviene elegir modelos con contexto largo (64k tokens o más) para que Claude Code pueda manejar proyectos grandes.

Dentro de Claude Code puedes usar el comando /loop para automatizar tareas repetitivas (revisar PRs, resumir incidencias, recordatorios). La sintaxis es:

/loop <intervalo> <prompt o /comando>

Por ejemplo, para que cada 30 minutos revise tus PRs abiertos y resuma su estado, o para lanzar cada hora una búsqueda de noticias sobre IA. El backend sigue siendo Ollama: el modelo que hayas elegido con ollama launch claude --model ... o con claude --model ... es el que ejecuta esas tareas.

Otras integraciones disponibles con ollama launch

ollama launch no se limita a Claude Code. El menú de integraciones incluye varias herramientas de asistencia de código:

- Codex (OpenAI): asistente de código en terminal que usa la API compatible con OpenAI de Ollama.

- Droid: herramienta de desarrollo asistido por IA.

- OpenCode: otro asistente de terminal para desarrollo.

Todas estas herramientas comparten el mismo principio: Ollama expone APIs compatibles (OpenAI, Anthropic) y la herramienta se conecta a esas APIs como si fueran los servicios originales. La elección de herramienta depende de tus preferencias y del ecosistema que uses.

ollama launch claude (y el menú ollama launch) simplifican el uso de Claude Code con Ollama. Con --model eliges modelo local o :cloud, con --config inspeccionas la configuración sin lanzar, y con variables de entorno puedes integrar el mismo flujo en tus propios scripts.

Alan Sastre

Ingeniero de Software y formador, CEO en CertiDevs

Ingeniero de software especializado en Full Stack y en Inteligencia Artificial. Como CEO de CertiDevs, Ollama es una de sus áreas de expertise. Con más de 15 años programando, 6K seguidores en LinkedIn y experiencia como formador, Alan se dedica a crear contenido educativo de calidad para desarrolladores de todos los niveles.

Más tutoriales de Ollama

Explora más contenido relacionado con Ollama y continúa aprendiendo con nuestros tutoriales gratuitos.

Aprendizajes de esta lección

Configurar y lanzar Claude Code usando Ollama como backend con ollama launch claude, el menú ollama launch y la opción --config para modelos locales y en la nube.

Cursos que incluyen esta lección

Esta lección forma parte de los siguientes cursos estructurados con rutas de aprendizaje